Co to jest dyfrakcja?

Justyna Miodońska • 9 marca 2026 • 10 min

Domykasz przysłonę do f/22, a w zamian otrzymujesz miękki, pozbawiony detali obraz? To paradoks dyfrakcji – tej samej, która maluje barwne wieńce wokół Księżyca i nadaje blask skrzydłom motyli, a Twoje filmy i fotografie bezlitośnie pozbawia ostrości. Przeczytaj o skutkach ugięcia się światła na krawędziach przysłony, o tym, czym jest limit dyfrakcyjny, a także dowiedz się, jak świadomie omijać prawa fizyki i odzyskać wyrazistość swoich kadrów!

Jak rozumieć dyfrakcję?

Zjawisko dyfrakcji jest mocno związane z naszym życiem codziennym i warto mieć świadomość tego, że w istotny sposób wpływa ono na naszą percepcję świata fizycznego.

Dyfrakcja towarzyszy człowiekowi niemalże na każdym kroku; umożliwia słyszenie dźwięków „zza rogu", obserwację wielu zjawisk optycznych na niebie, a także dostrzeżenie fenomenalnych kolorów fauny i flory – to wszystko nie mogłoby się wydarzyć, gdyby nie proces ugięcia fali, która w wyniku „napotkania" przeszkody, zmienia swój prostoliniowy kierunek rozchodzenia się w przestrzeni.

Oczywiście nas, filmowców i fotografów, zjawisko to interesuje przede wszystkim w kontekście jego wpływu na jakość cyfrowych obrazów oraz zdolność rozdzielczą soczewek tworzących konstrukcję danego obiektywu.

Chciałabym jednak podkreślić, że dyfrakcja oddziałuje nie tylko na optyczne fale elektromagnetyczne, ale także na te mechaniczne – akustyczne, fale na wodzie czy też sejsmiczne fale wewnątrz Ziemi.

W momencie, gdy któraś z tych konkretnych fal napotka na swojej drodze geometryczne ograniczenie o zróżnicowanych właściwościach fizycznych – np. szczelinę, krawędź lub wąski otwór przysłony obiektywu – to zaczyna działać tzw. zasada Huygensa.

W myśl tej reguły każdy punkt, do którego dociera taka fala, staje się nowym źródłem kulistych fal cząstkowych interferujących ze sobą – czyli nakładających się na siebie – co w efekcie prowadzi do powstania obrazu dyfrakcyjnego, który może zarejestrować nasze oko, ucho (tak, ono także!) lub matryca aparatu.

Ciekawi Cię jak dyfrakcja objawia się na co dzień w Twoim otoczeniu? W poniższej tabeli znajdziesz wiele intersujących przykładów jej manifestacji:

| rodzaj zjawiska | opis |

| Wieniec (zjawisko optyczne) |

Jest to barwna aureola wokół Słońca lub Księżyca, która powstaje w momencie przysłonięcia ich delikatną, transparentną warstwą chmur lub mgły, wewnątrz których dochodzi do ugięcia się fal świetlnych. Wewnętrzny pierścień aureoli ma zwykle barwę niebieską, a zewnętrzny – czerwoną. Wieniec można zazwyczaj zaobserwować w wyniku dyfrakcji kropel wody w chmurach kłębiastych, takich jak Cirrocumulus lub Stratocumulus. |

| Gloria (zjawisko optyczne) |

Wizualnie przypomina ona wieniec, jednak w tym przypadku tęczowa obwódka powstaje dookoła tzw. punktu antysłonecznego, czyli miejsca położonego po przeciwnej stronie względem tarczy Słońca. Dyfrakcja światła zachodzi tutaj na krawędziach kropelek wody lub kryształków lodu, których wielkość definiuje również rozmiar glorii. |

| Widmo Brockenu (zjawisko optyczne) |

Nazywa się je często mamidłem górskim, ponieważ to właśnie wysoko w górach (konkretnie w paśmie Harz) zostało zaobserwowane po raz pierwszy. To zjawisko może dostrzec tylko jego obserwator, który znajduje się dokładnie na linii słońca i mgły – pełniącej rolę „ekranu" dla samego zjawiska (koniecznie poniżej samego obserwatora), na którym pojawia się jego osobliwie duży cień otoczony wielobarwną obwódką: wspomnianą już glorią. |

|

Halo (zjawisko optyczne) |

Powstaje wskutek ugięcia się fal świetlnych w chmurze zawierającej kryształki lodu (np. w chmurze typu Cirrus) w wyższych warstwach atmosfery. Jest to świetlisty, zwykle jednobarwny pierścień wokół tarczy Słońca lub Księżyca, o bardzo regularnym kształcie. |

|

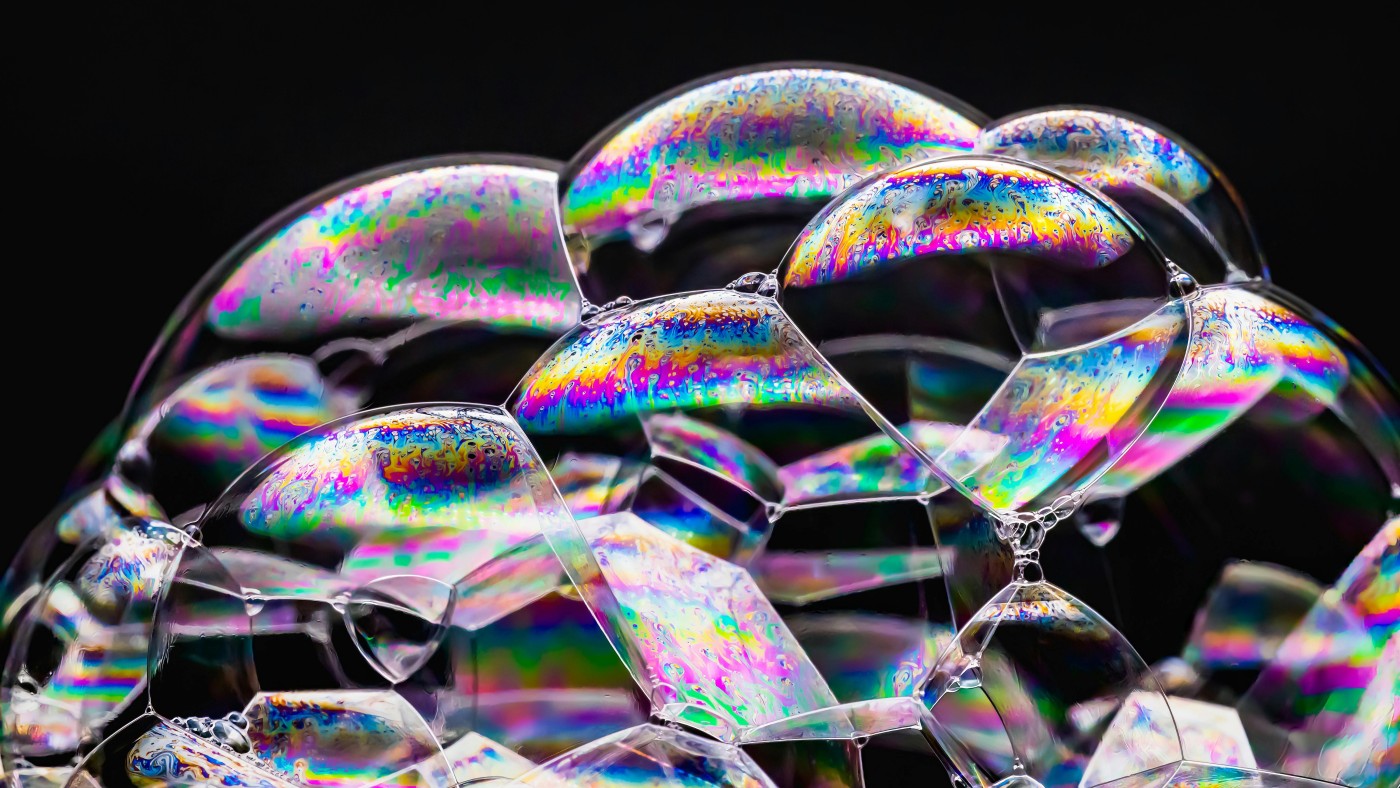

Iryzacja (zjawisko optyczne) |

To zjawisko nazywa się potocznie tęczowaniem, ponieważ polega na powstawaniu tęczowych barw na powierzchni (pół)przezroczystych ciał w wyniku nakładania się na siebie (interferencji) odbitych fal światła białego. |

Wpływ dyfrakcji na obraz filmowy i fotograficzny

Ugięcie fali świetlnej oraz wynikające z tego „konsekwencje" nie są obojętne względem materiałów, które zapisujemy na cyfrowych nośnikach.

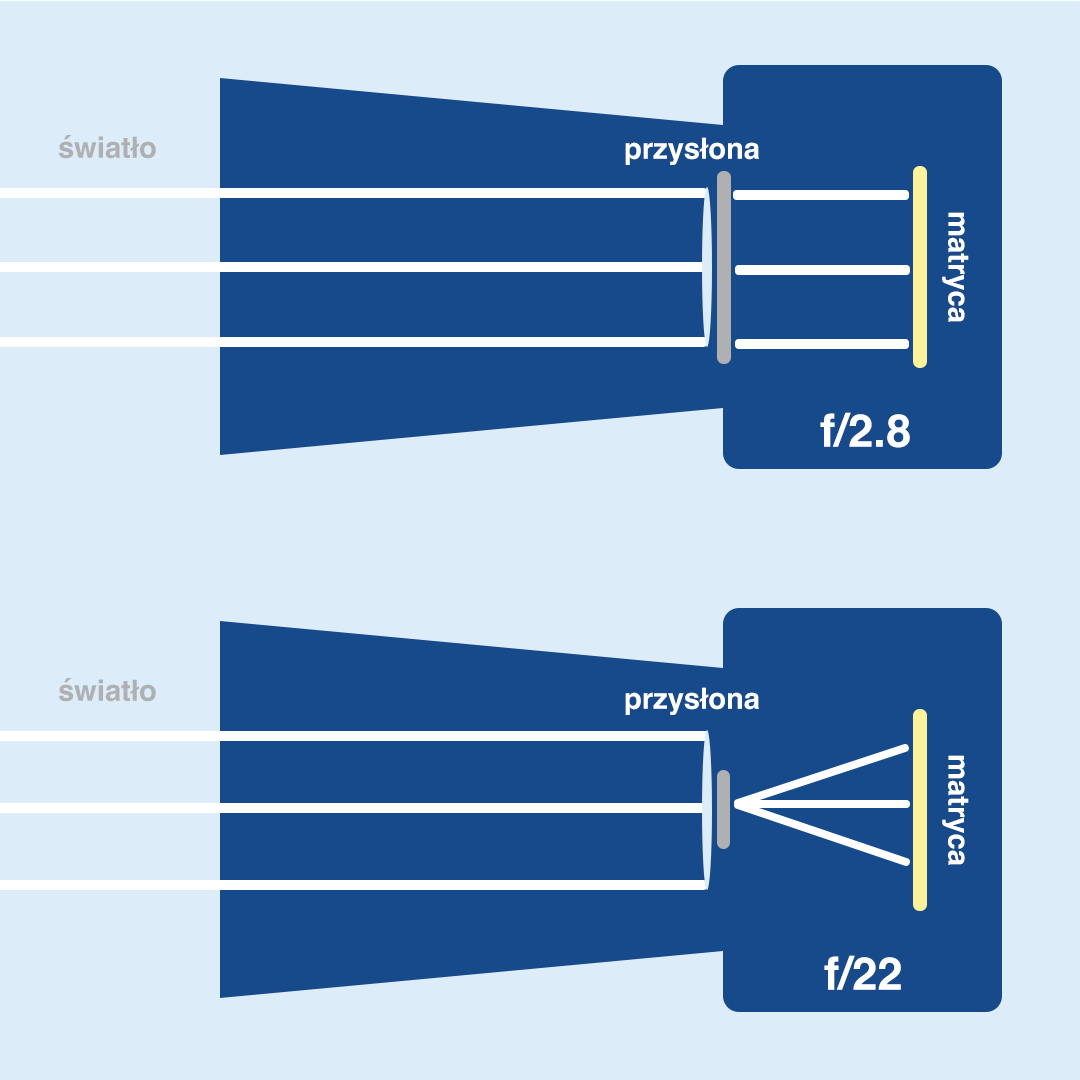

Zjawisko dyfrakcji prowadzi bowiem do jednego z największych paradoksów w kontekście wyrazistości detali obrazu fotograficznego, gdy w wyniku przymykania przysłony obiektywu – a więc analogicznego powiększenia głębi ostrości – finalnie nie osiąga on w ogóle przyzwoitej jakości odwzorowania szczegółów.

Dlaczego tak się dzieje? Winowajcami są tutaj rozmiar otworu przysłony oraz limit dyfrakcyjny.

Znaczenie krążka Airy’ego

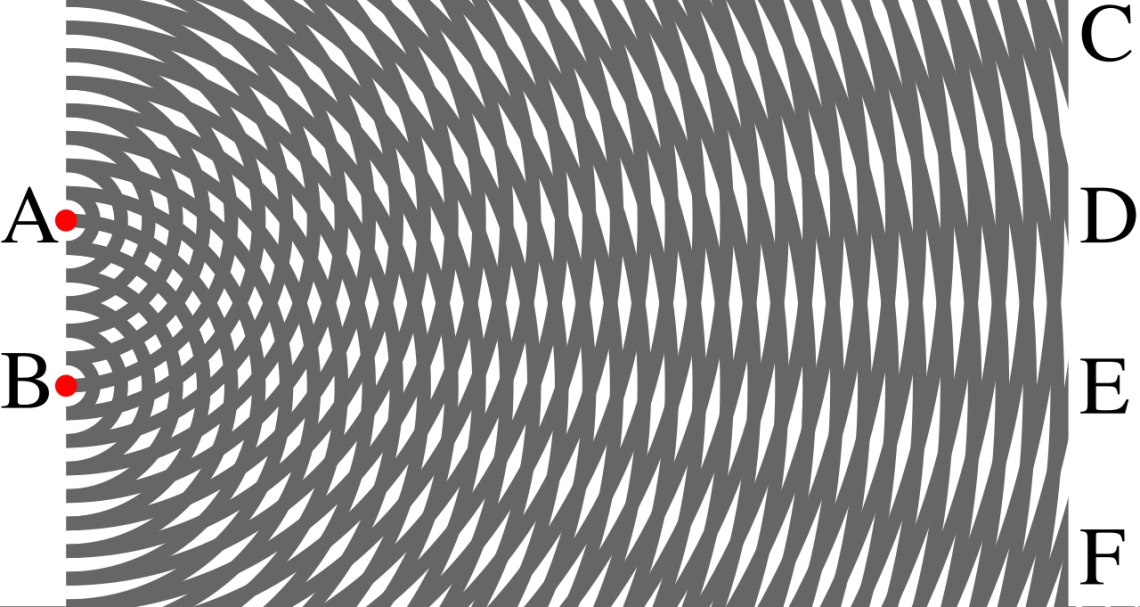

W sytuacji, gdy otwór przysłony jest zbyt mały, promienie światła uginają się na jej krawędziach – ugięcie będzie tym większe, im mniejszy będzie stosunek wielkości otworu przysłony do długości fali świetlnej – i dochodzi do wspomnianej już wcześniej interferencji fal.

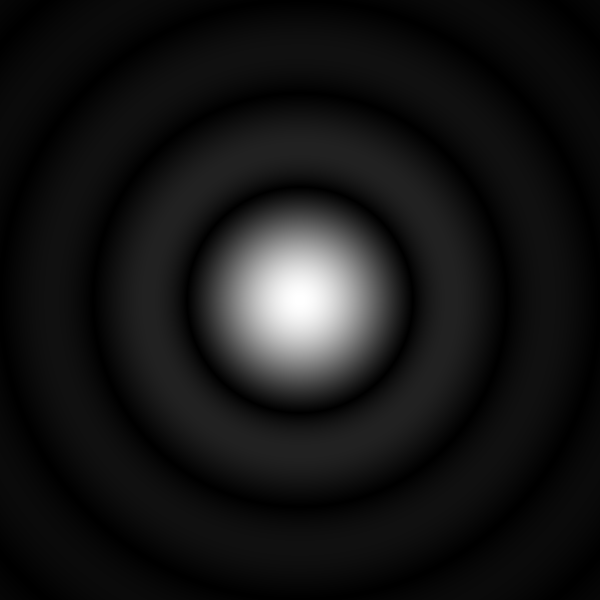

Nałożone na siebie fale świetlne tworzą obraz dyfrakcyjny, który na matrycy przyjmuje postać niewyraźnego, jasnego punktu otoczonego prążkami o różnym stopniu jasności – świat fizyki nazywa go krążkiem Airy’ego:

- w przypadku wąskiej przysłony, o dużej wartości liczbowej – np. f/22 – powstałe na matrycy krążki są większe niż piksele budujące matrycę, a gdy zaczynają na siebie nachodzić (interferować), to nasze oko postrzega to jako niewyraźny obraz o niskim kontraście; jako ciekawostkę dodam, że światło czerwone z powodu długości swojej fali ugina się mocniej niż pozostałe składowe widma światła widzialnego, co skutkuje szybszym rozmyciem czerwonych elementów w kadrze,

- w przypadku „szerokiej" przysłony, a więc przy użyciu jej małych wartości liczbowych – np. f/2.8 – krążki Airy’ego powstające na matrycy są mniejsze od pikseli sensora, co skutkuje ostrym obrazem.

Znaczenie wielkości piksela

Dyfrakcja powstająca na cyfrowym obrazie ma również nierozerwalny związek z rozmiarem światłoczułego sensora, a konkretniej z rozmiarem budujących go pikseli – im są one mniejsze, tym szybciej dochodzi do degradacji obrazu pod kątem wrażenia ostrości.

Wiesz już o tym, jak ogromne znaczenie ma „relacja wielkościowa" krążka Airy’ego względem pojedynczego piksela – wyznacza ona tzw. limit dyfrakcyjny, czyli wartość przysłony, przy której ów krążek staje się większy niż pojedynczy piksel na matrycy:

- pełnoklatkowe przetworniki obrazu zbudowane z dużych pikseli (np. matryca aparatu Sony A7S III) mają zdecydowanie „zwiększoną tolerancję" na zjawisko dyfrakcji, ponieważ w ich przypadku punktowy obraz światła ma mniejszy lub zbliżony rozmiar do pojedynczego piksela,

- z kolei sensory niepełnoklatkowe, które mogą charakteryzować się wysoką rozdzielczością, paradoksalnie dużo szybciej osiągną wspomniany limit dyfrakcyjny; przez ich niewielki rozmiar, krążek Airy’ego znacznie szybciej zaczyna pokrywać obszar kilku sąsiednich pikseli naraz, co efektywnie obniża ostrość obrazu już przy średnich wartościach przysłony.

Czy istnieje obraz idealnie ostry?

Warto zapamiętać, że ludzkie oko, podobnie jak i każda soczewka optyczna, ma swoją maksymalną zdolność rozdzielczą ograniczoną zjawiskiem dyfrakcji, którą w środowisku naukowym określa kryterium Rayleigha – jest to limit, który powoduje, że niemożliwym jest po prostu zobaczenie (przez człowieka), a także optyczne odwzorowanie (przez soczewkę) idealnie ostrych punków; rozmycia obrazu w sensie absolutnym nie wyeliminuje żadna soczewka, nawet ta o najdoskonalszej konstrukcji, ponieważ nieostrość wynika z samej natury światła.

Krążek Airy’ego jest zatem dowodem na to, że w fizyce nie istnieje coś takiego jak całkowicie ostry obraz – dlatego pojęcie ostrości, jako waloru obrazu, zawsze powinniśmy analizować w kontekście stopnia rozmycia, a nie jego całkowitego braku.

Ciekawostką jest, że zjawisko dyfrakcji nie było także obce neoimpresjonistycznym malarzom, którzy ograniczoną zdolność rozdzielczą ludzkiego oka wykorzystali na poczet stworzenia innowacyjnej techniki zwaną pointylizmem.

Strukturę obrazu wykonaną ową techniką tworzą maleńkie plamki podstawowych kolorów usianych gęsto obok siebie, które oglądane z odpowiedniej odległości mieszają się na siatkówce oka i dopiero na niej tworzą finalną paletę barw obrazu – artyści zauważyli, że płótno pokryte „punktową farbą" działa jak siatka dyfrakcyjna, która rozszczepia białe światło na poszczególne składowe widma o wyjątkowym nasyceniu i świetlistości kolorów.

Jak ograniczyć dyfrakcję podczas fotografowania i filmowania?

- znajdź tzw. sweet spot danego obiektywu – zdecydowana większość szkieł oferuje najlepszą zdolność rozdzielczą układu optycznego w średnim zakresie przysłon (np. f/5.6 – f/8); gdy zależy Ci na maksymalnej wyrazistości detali w kadrze, to staraj się wybierać wartość f/ zawsze „gdzieś pośrodku", a najlepiej przeprowadź indywidualny test własnych obiektywów,

- unikaj skrajnie dużych wartości przysłony i pamiętaj o jej „dopasowaniu" do matrycy – dla pełnej klatki bezpieczna granica to przysłona f/11, natomiast dla matryc APS-C i mniejszych – f/8 (im mniejszy sensor, tym szybciej pojawia się dyfrakcja),

- używaj szarych filtrów ND – w sytuacji, gdy zbyt dużo światła pada na matrycę, nie przymykaj przysłony, tylko ogranicz swoją ekspozycję za pomocą filtra ND; wówczas zachowasz wspomniany sweet spot, a nadmiar światła odetniesz z pomocą zewnętrznego filtra,

- skorzystaj z techniki Focus Stacking – jeśli zależy Ci na dużej głębi ostrości, to skorzystaj z funkcji stackowania obrazów – wiele współczesnych aparatów umożliwia bezpośrednie połączenie kilku zdjęć już w samym aparacie – lub wykonaj kilka ujęć, ostrząc na różne plany tego samego kadru, a następnie połącz je w całość w programie graficznym,

- zachowaj odpowiednią odległość względem fotografowanego obiektu – głębia ostrości zależy od trzech czynników: wartości przysłony, ogniskowej oraz właśnie od odległości względem danego obiektu; zamiast radykalnie domykać przysłonę, czasem wystarczy odpowiednio odsunąć się od motywu, który fotografujesz – głębia się wówczas naturalnie zwiększy – a następnie w postprodukcji, jeśli pozwala na to rozdzielczość matrycy, wykadruj fotografię w taki sposób, jak miała zostać pierwotnie wykonana.

Sprawdź inne artykuły w kategorii Poradników:

Co kryje w sobie standard EXIF?

Jak standard C2PA chroni Twoje cyfrowe treści?

Grafika w banerze – Robert So

Najnowsze

Zostań naszym stałym czytelnikiem

Bądź na bieżąco z nowościami foto-wideo, inspiruj się wybitnymi twórcami, korzystaj z praktycznych porad specjalistów.

Poinformujemy Cię o super promocjach, interesujących kursach i warsztatach.